Warum Lippen-Synchronisation für jeden arabischen Laut

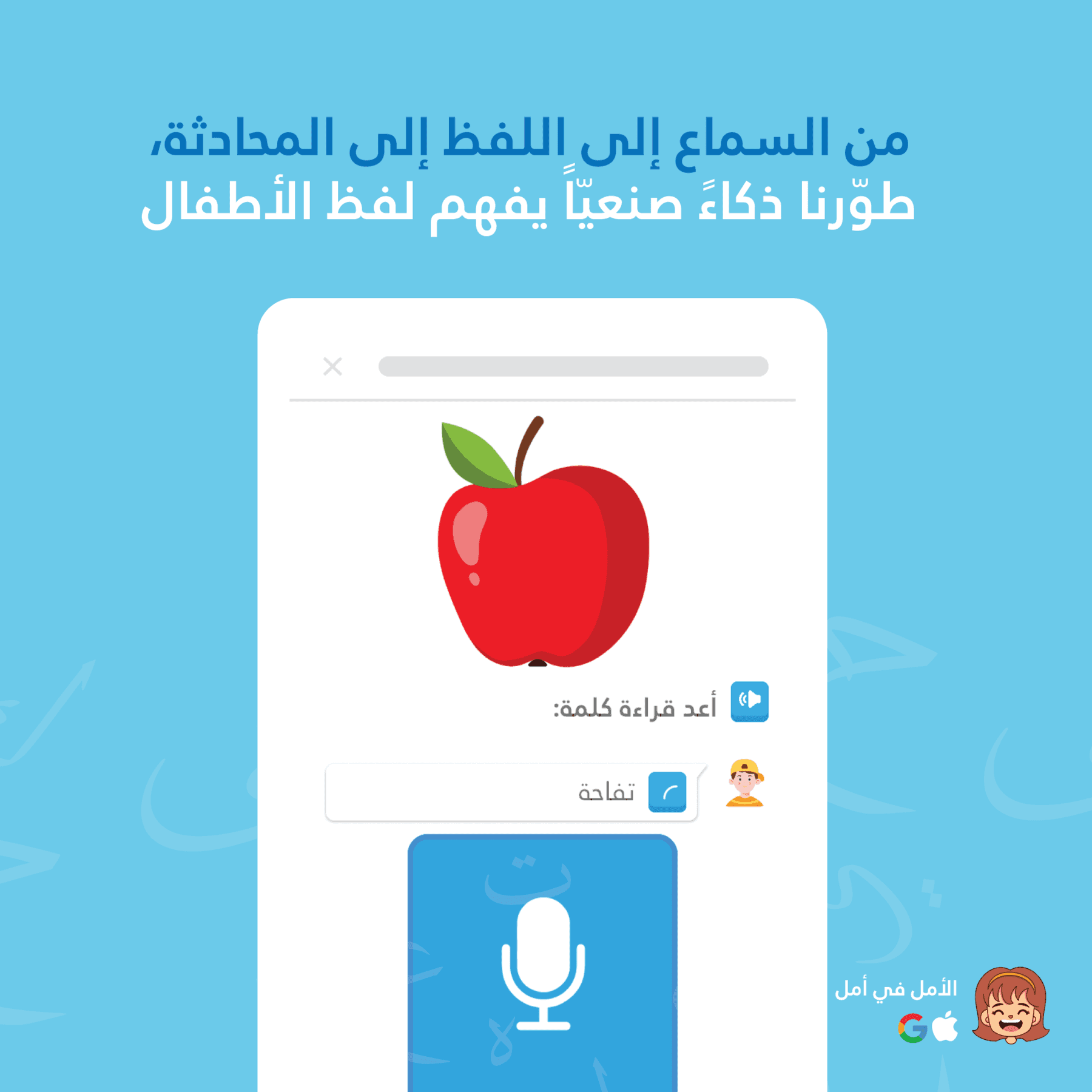

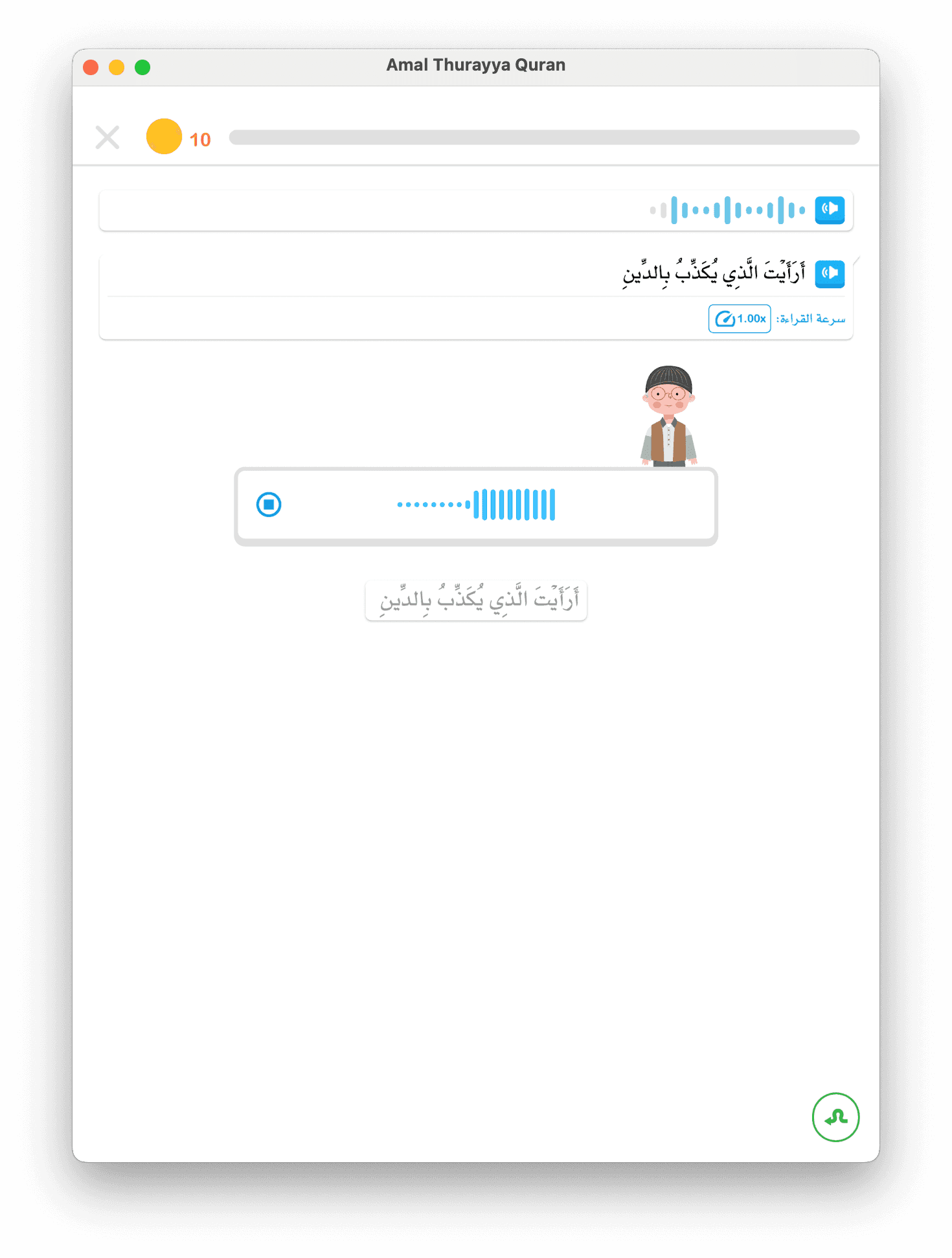

Amal verwendet von Rive betriebene Lippen-Synchronisations-Animationen, um Kindern genau zu zeigen, wie jeder arabische Laut gebildet wird — der Mund der Figur bewegt sich synchron zur Audioaussprache. Dieser visuell-phonetische Ansatz hilft Kindern, die Aussprache intuitiv zu lernen, besonders bei Lauten, die im Englischen nicht existieren (wie ع, خ, غ, ح).

Das Problem: Arabisch hat Laute, die es im Englischen nicht gibt

Arabische Phonetik umfasst:

- Pharyngale Konsonanten (ع, ح): tief im Rachen gebildet, kein englisches Äquivalent

- Uvulare Konsonanten (ق, خ, غ): hinten im Mund gebildet

- Emphatische Konsonanten (ص, ض, ط, ظ): mit Zurückziehen der Zunge ausgesprochen

Wie das Lippen-Synchronisationssystem funktioniert

Die Rive-Animations-Engine

Rive (ehemals Flare) ist ein 2D-Animationssystem mit Zustandsmaschinen-Unterstützung. Wir nutzen es, weil:

- Zustandsmaschinen ermöglichen fließende Übergänge zwischen Leerlauf → Sprechen → Fehler → Feier

- Runtime-Manipulation: Wir ändern die Mundposition programmatisch, nicht durch das Abspielen vorgerenderter Sequenzen

- Eine einzelne `.riv`-Datei enthält alle Animationszustände (vs. Hunderten von Sprite-Frames)

- GPU-beschleunigt, 60fps auf Mittelklasse-Geräten

Sprachmarken-Pipeline

- Text-to-Speech generiert Audio für "أَنَا" (ich)

- TTS liefert "Sprachmarken" — genaue Zeitstempel für jedes Phonem

- Unser `lip_sync_avatar.json` ordnet Phoneme → Rive-Mundzustände zu

- `LipSyncController` steuert Zustandsübergänge synchron mit der Wiedergabe

- Das Kind sieht, wie der Mund der Figur die richtige Position bildet, während es den Laut hört

TTS-Audio + Sprachmarken

↓

[Phonem-Timing extrahieren]

↓

[Rive-Zustände zuordnen]

↓

[Charaktermund animieren]

↓

[Kind sieht Mundposition]

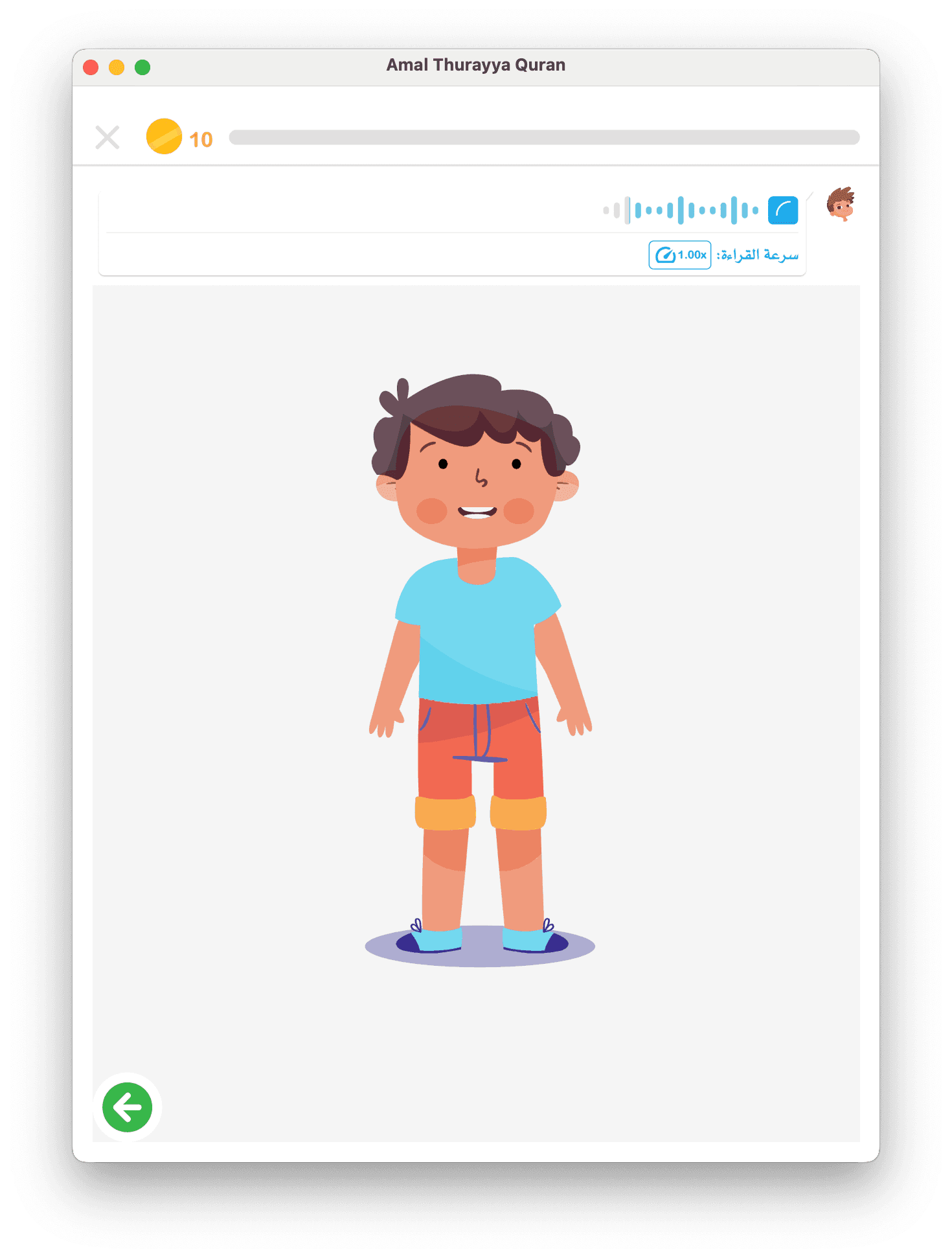

Mehrere Charaktervarianten

- Hauptfigur Amal mit Ganzkörper- und Gesichtsvarianten

- Freundliche Hilfscharaktere für Vielfalt und Engagement

- Anpassbare Avatare: Kinder wählen Kopfform, Kleidung, Farben, Accessoires

- Emotionale Zustände: Leerlauf, Sprechen, Fehler (ermutigend), Feier (Lob)

Warum Rive (nicht Lottie oder Sprite-Sheets)

| Ansatz | Zustandsmaschinen | Laufzeitkontrolle | Dateigröße | Leistung | Kosten |

|---|---|---|---|---|---|

| Rive | ✓ | ✓ | 1.2 MB | 60fps | Entwicklungszeit |

| Lottie | ✗ | Teilweise | 2-3 MB | 30fps | Animationszeit |

| Sprites | ✗ | Manuell | 50+ MB | 60fps | Speicherplatz |

| Video | N/A | ✗ | 100+ MB | Variabel | Hostingkosten |

Rive gewinnt, weil wir programmgesteuerte Kontrolle, Zustandsübergänge und kompakte Dateigrößen für eine mobile App benötigen, die 95.000+ Kinder bedient.

Bildungsauswirkung

Untersuchungen zeigen, dass visuell-phonetisches Lernen (Mundposition sehen beim Hören des Lauts) die Ausspracheerlernung beschleunigt. Unsere internen Daten:

- Kinder, die Lippen-Sync sehen, lernen 40% schneller Aussprache

- Aussprachegenauigkeit verbessert sich 3x schneller mit visuellem Feedback

- Besonders effektiv für Diasporakinder ohne arabische Sprecher zu Hause

Warum Konkurrenten dies nicht nachmachen können

Um dies zu reproduzieren, benötigt man:

- Phonetik-Expertise (zu wissen, welche Mundpositionen zu welchen Lauten passen)

- Rive-Animationsfähigkeiten (nicht trivial — das Entwerfen von Zustandsmaschinen ist komplex)

- TTS-Sprachmarken-Integration (nicht alle TTS-Anbieter bieten dies an)

- Mobile Optimierung (Rive-Rendering mit 60fps auf verschiedenen Geräten)

- Charakteranpassungssystem (Komponentenbasierte Avatar-Architektur)

FAQ

F: Kann mein Kind die Animationsgeschwindigkeit anpassen?

A: Ja. Langsamere Geschwindigkeiten helfen bei schwierigen Lauten; schnellere Geschwindigkeiten sind für fortgeschrittene Lerner. Die App passt sich basierend auf der Leistung an.

F: Haben alle Übungen Lippen-Synchronisation?

A: Laut-Aussprache- und Sprech-Übungen beinhalten volle Lippen-Synchronisation. Andere Übungsarten (Spiele, Puzzles) nutzen die Figur für Ermutigungs- und Belohnungsanimationen.

F: Warum zeigt die Figur manchmal eine Fehleranimation?

A: Wenn die Spracherkennung eine falsche Aussprache erkennt, zeigt die Figur sanft einen "Nochmals versuchen"-Ausdruck. Das ist ermutigend, nicht strafend — Kinder lernen durch wiederholte Versuche.